我们收集了一些与大型语言模型(LLM)相关的文章,观点,视频和资源。其中一些链接还涵盖了其他生成模型。我们将定期更新此列表,以添加任何其他感兴趣的资源。本文是该系列的第三篇。(以前的版本在这里:v1 |v2.)

什么是法学硕士以及它们是如何工作的

什么是生成AI模型?,Kate Soule,来自IBM Technology的视频。

大型语言模型简介,John Ewald,来自Google Cloud Tech的视频。

什么是 GPT-4,它与 ChatGPT 有何不同?,Alex Hern,《卫报》。

查特在做什么...以及为什么它有效?,斯蒂芬·沃尔夫勒姆。

理解大型语言模型——变革性阅读清单,塞巴斯蒂安·拉施卡。

ChatGPT 如何训练,视频由 Ari Seff 提供。

ChatGPT – 这是什么?它是如何工作的?我们应该兴奋吗?还是害怕?,Deep Dhillon,The Radical AI播客。

您需要了解的有关ChatGPT,Joanna Dungate,图灵研究所博客的所有信息。

吟游诗人常见问题解答,谷歌。

从头开始的大型语言模型 |大型语言模型:第 2 部分,5 分钟内来自图形的视频。

什么是大型语言模型(LLM)?,来自Google for Developers的视频。

Risks of Large Language Models (LLM),Phaedra Boinodiris,来自 IBM Technology 的视频。

ChatGPT和其他LLM是如何工作的——以及他们下一步可以去哪里,David Nield,Wired。

什么是大型语言模型,机器学习掌握。

如何从ChatGPT中删除您的数据,Matt Burgess,Wired。

ChatGPT 可以改进而不是取代您的写作的 5 种方式,David Nield,连线。

人工智能提示工程:学习如何不问聊天机器人一个愚蠢的问题,Callum Bains,卫报。

期刊、会议、arXiv和其他文章

科学家对生成人工智能在其领域的潜力的看法,Meredith Ringel Morris,arXiv。

LaMDA: Language Models for Dialog Applications, Romal Thoppilan et al, arXiv.

如果你有一百万小时的GPU小时,要训练什么语言模型?,Teven Le Scao et al,arXiv。

羊驼:一个强大的,可复制的指令遵循模型,Rohan Taori等人。

使用价值目标数据集使语言模型适应社会的过程 (PALMS),艾琳·索莱曼、克里斯蒂·丹尼森,NeurIPS 2021。

关于随机鹦鹉的危险:语言模型会太大吗?

,艾米丽·本德,蒂姆尼特·格布鲁,安吉丽娜·麦克米兰-梅杰,什玛格丽特·什米切尔,FAccT 2021。

A Survey of Large Language Models, Wayne Xin Zhao et al, arXiv.

A Watermark for Large Language Models, John Kirchenbauer, Jonas Geiping, Yuxin Wen, Jonathan Katz, Ian Miers, Tom Goldstein, arXiv.

在主观性与强加之间:计算机视觉数据注释中的权力动力学,Milagros Miceli,Martin Schuessler,Tianling Yang,ACM关于人机交互的论文集。

用于指示 AI 编写文本的 AI 分类器,OpenAI。

Pythia:用于跨训练和扩展分析大型语言模型的套件,Stella Biderman et al,arXiv。

GPT-4 技术报告,OpenAI,arXiv。

GPT-4 系统卡,OpenAI。

BloombergGPT: A Large Language Model for Finance, Shijie Wu et al, arXiv.

基于水印的AI生成内容规避检测, 蒋正元, 张景怀, 龚振强, arXiv.

PaLM 2 技术报告,谷歌。

大型语言模型(LLM)和ChatGPT:对核医学的影响是什么?,Ian L. Alberts,Lorenzo Mercolli,Thomas Pyka,George Prenosil,Kuangyu Shi,Axel Rominger和Ali Afshar-Oromieh,Eur J Nucl Med Mol Imaging。

医学和医学研究中大型语言模型的伦理学,Hanzhou Li,John T Moon,Saptarshi Purkayastha,Leo Anthony Celi,Hari Trivedi和Judy W Gichoya,柳叶刀。

大型语言模型时代的科学,Abeba Birhane,Atoosa Kasirzadeh,David Leslie和Sandra Wachter,Nature。

使用语言模型标准化化合物,Miruna T Cretu,Alessandra Toniato,Amol Thakkar,Amin A Debabeche,Teodoro Laino和Alain C Vaucher,机器学习:科学和技术。

如何保持文本私密?对用于隐私保护自然语言处理的深度学习方法的系统综述,Samuel Sousa & Roman Kern,人工智能评论。

材料转换器:用于生成材料设计的深度学习语言模型,Nihang Fu,Lai Wei,Yuqi Song,李沁阳,Rui Xin,Sadman Sadeed Omee,Rongzhi Dong,Edirisuriya M Dilanga Siriwardane和Jianjun Hu,机器学习:科学和技术。

大型语言模型编码临床知识,Karan Singhal等人,Nature。

SELFormer:通过SELFIES语言模型进行分子表示学习,Atakan Yüksel,Erva Ulusoy,Atabey Ünlü和Tunca Doğan,机器学习:科学和技术。

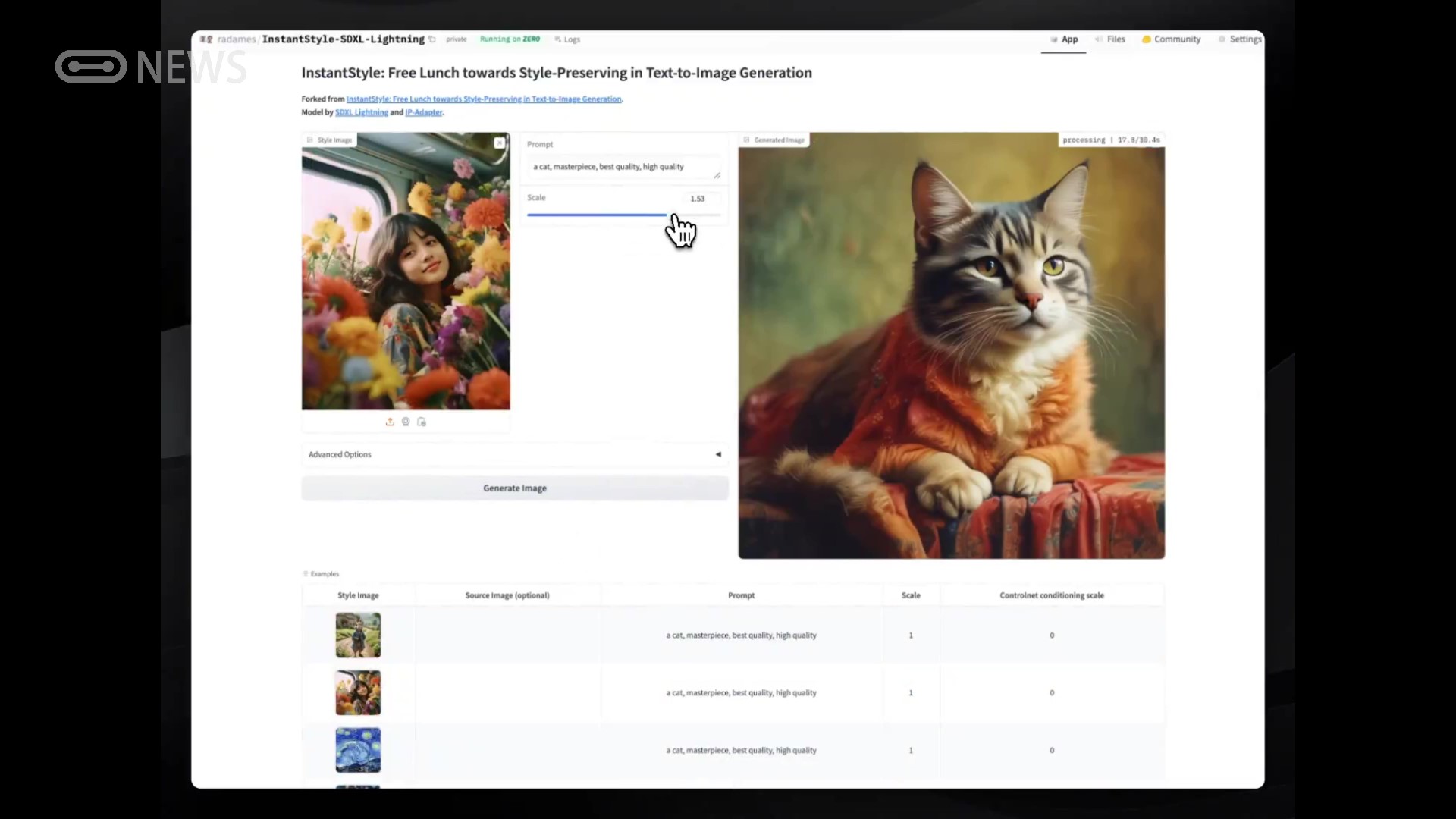

GPT-4 + 稳定扩散 = ?:使用大型语言模型增强对文本到图像扩散模型的快速理解,Long Lian,Boyi Li,Adam Yala和Trevor Darrell,BAIR博客。

报纸、杂志、大学网站和博客文章

为什么针对人类的考试可能不是像GPT-4,Ben Dickson,Venture Beat这样的LLM的良好基准。

GPT-4真的明白我们在说什么吗?,David Krakauer,Nautilus。

大型语言模型是有偏见的。逻辑能帮助拯救他们吗?,雷切尔·戈登,麻省理工学院新闻。

机器学习模型及其关系的生态系统图,斯坦福大学的研究人员。

ChatGPT在Wordle谜题上挣扎,这说明了很多关于它是如何工作的,Michael G. Madden,The Conversation。

AIhub咖啡角:用于科学写作的大型语言模型,AIhub。

ChatGPT是一个模糊的网络JPEG,Ted Chiang,纽约客。

ChatGPT,Galactica和Progress Trap,Abeba Birhane和Deborah Raji,Wired。

ChatGPT不能骗你,但你仍然不应该相信它,麦肯齐格雷厄姆,对话。

AI信息检索:一位搜索引擎研究人员解释了让ChatGPT及其表亲在网络上搜索你的承诺和危险,Chirag Shah,The Conversation。

研究的一小步,但实用性的巨大飞跃,林雪平大学弗雷德里克·海因茨访谈。

ChatGPT威胁着语言多样性。需要做更多的工作来保护我们在人工智能时代的差异,Collin Bjork,The Conversation。

专栏:怕人工智能?销售它的初创公司希望你成为,Brian Merchant,洛杉矶时报。

人工智能聊天机器人是安全灾难的三种方式,Melissa Heikkilä,麻省理工学院技术评论。

时间:OpenAI使用肯尼亚工人每小时不到2美元来降低ChatGPT的毒性,Billy Perrigo,TIME。

对“邪恶”ChatGPT的错误恐惧掩盖了正在造成的真正伤害,约翰·诺顿,卫报。

Darktrace警告说,自ChatGPT发布以来,人工智能增强型骗局有所增加,马克·斯威尼,卫报。

立法者努力区分人工智能和人类电子邮件,凯特布莱克伍德,康奈尔纪事报。

哥伦比亚法官说,他在裁决中使用了ChatGPT,卢克泰勒,卫报。

Bhashini:由ChatGPT提供支持的印度语言聊天机器人,来自《经济时报》的视频。

ChatGPT & Co.:大型语言模型的会话能力,Marisa Tschopp,Luca Gafner,Teresa Windlin,Yelin Zhang,SCIP。

人工智能机器不会“产生幻觉”。但他们的制作者是《卫报》的娜奥米·克莱因

谷歌推出新的AI PaLM 2,试图重新获得领导地位,Alex Hern,卫报。

高管们担心与ChatGPT意外共享公司数据:报告,Victor Dey,Venture Beat。

编辑来信:生成人工智能如何塑造新闻业和我们的新闻编辑室的未来,Michael Nuñez,Venture Beat。

ChatGPT是如何从制作它的人那里建立起来的内幕,Will Douglas Heaven,MIT Tech Review。

一个提出问题的聊天机器人可以帮助你发现什么时候没有意义,Melissa Heikkilä,麻省理工学院技术评论。

为生产构建LLM应用程序,Chip Huyen。

生成式人工智能不会彻底改变搜索——然而,Ege Gurdeniz和Kartik Hosanagar,哈佛商业评论。

如果AI图像生成器如此智能,为什么它们很难书写和计数?,Seyedali Mirjalili,The Conversation。

“它完全摧毁了我”:肯尼亚版主谴责人工智能模型训练的代价,Niamh Rowe,卫报。

OpenAI推出网络爬虫GPTBot,引发了网站所有者和创建者的阻止工作,Bryson Masse,Venture Beat。

为什么不可能建立一个公正的人工智能语言模型,Melissa Heikkilä,麻省理工学院技术评论。

如何在保护您的隐私的同时使用生成式 AI 工具,David Nield,连线。

不要辞掉你的日常工作:生成人工智能和编程的终结,Mike Loukides,Venture Beat。

OpenAI添加了“大量”ChatGPT更新,包括建议的提示,多个文件上传,Carl Franzen,Venture Beat。

年龄歧视,性别歧视,阶级歧视等等:人工智能生成的图像中偏见的7个例子,T.J. Thomson和Ryan J. Thomas,The Conversation。

ChatGPT的“开放”替代品正在兴起,但人工智能到底有多开放?,Radboud大学。

视觉字幕:使用大型语言模型通过动态视觉效果增强视频会议,Ruofei Du和Alex Olwal,谷歌。

为什么给人工智能生成的内容加水印并不能保证在线信任,Claire Leibowiczarchive页面,麻省理工学院技术评论。

报告

ChatGPT及更多:大规模AI模型巩固了大型技术力量,这是AI Now Institute报告的一部分。

播客和视频讨论

ChatGPT的局限性与Emily M. Bender和Casey Fiesler,Radical AI Podcast。

苏琳·布洛杰特谈创造公正的语言技术,好的机器人播客。

与Sam Charrington合作的TWIML AI播客有许多关于LLM和生成AI主题的剧集。

专注于法学硕士和教育

观点:ChatGPT – 这对学术诚信意味着什么?,吉赛尔·伯恩斯,梅西大学。

辩论:ChatGPT提供了看不见的机会来提高学生的关键技能,Erika Darics,Lotte van Poppel,The Conversation。

ChatGPT和作弊:改变学生评分方式的5种方法,Louis Volante,Christopher DeLuca,Don A. Klinger,The Conversation。

ChatGPT:学生可以使用人工智能作弊,但这是一个重新思考评估的机会,Sam Illingworth,The Conversation。

ChatGPT 的教师提示指南,@herfteducator。

教育工作者应该担心ChatGPT吗?,采访伊利诺伊大学的Jodi Heckel。

大型语言模型挑战高等教育的未来,Silvia Milano,Joshua A. McGrane和Sabina Leonelli,Nature。

ChatGPT,(我们需要谈谈),与剑桥大学的Vaughan Connolly和Steve Watson的问答。

不要担心学生使用ChatGPT作弊 - 人工智能是对教育平等的更大威胁,Collin Bjork,The Conversation。

医学教育中的大型语言模型:机遇,挑战和未来方向,Alaa Abd-Alrazaq,Rawan AlSaad,Dari Alhuwail,Arfan Ahmed,Padraig Mark Healy,Syed Latifi,Sarah Aziz,Rafat Damseh,Sadam Alabed Alrazak和Javaid Sheikh,JMIR医学教育。

大型语言模型和教育,马斯特里赫特大学。

与艺术和其他创作过程有关

“ChatGPT说我不存在”:艺术家和作家如何反击AI,Vanessa Thorpe,卫报。

人工智能和工作的未来:5位关于ChatGPT,DALL-E和其他AI工具对艺术家和知识工作者意味着什么的专家,Lynne Parker,Casey Greene,Daniel Acuña,Kentaro Toyama Mark Finlayson,The Conversation。

有没有办法支付那些工作用于训练人工智能的内容创作者?是的,但这不是万无一失的,布伦丹·保罗·墨菲,对话。

ChatGPT是高等教育需要重新思考评估的推动力,Sioux McKenna,Dan Dixon,Daniel Oppenheimer,Margaret Blackie,Sam Illingworth,The Conversation。

AI Art: How artists Are Use and Face the Machine Learning,YouTube视频,来自现代艺术博物馆。

“我们厌倦了等待Oasis重新组建”:AIsis,乐队由AI Liam Gallagher,Rich Pelley,The Guardian领导。

摄影师承认获奖图像是人工智能生成的,杰米格里尔森,卫报。

用文本到图像生成AI制作艺术的愚蠢,Ahmed Elgammal,The Conversation。

计算机编写的剧本和深度伪造的演员:好莱坞打击生成人工智能的核心是什么,Jasmin Pfefferkorn,对话。

演员们真的很担心电影制片厂使用人工智能——他们可能有道理,多米尼克·李斯(Dominic Lees),《对话》。

与机器人技术有关

ChatGPT for Robotics: Design Principles and Model Ability, Microsoft.

《内心独白:通过语言模型规划的具身推理》,黄文龙等,arXiv.

PaLM-E:一个具体的多模态语言模型,Danny Driess,谷歌。

意识,体现,语言模型(与Murray Shanahan教授合作),来自机器学习街头谈话的YouTube视频。

RoCo:与大型语言模型的辩证多机器人协作,赵曼迪,Shreeya Jain和Shuran Song,arXiv。

真棒LLM机器人,GitHub存储库,其中包含使用LLM进行机器人和强化学习的论文的治疗性列表。

LLM如何改变机器人设计过程?,Francesco Stella,Cosimo Della Santina和Josie Hughes,Nature。

错误信息、假新闻及其对新闻业的影响

假新闻狂潮:为什么ChatGPT对新闻业的真相可能是灾难性的,艾米丽贝尔,卫报。

Defending Against Neural Fake News, Rowan Zellers et al, arXiv.

篡改的苏纳克照片只是一系列政治深度伪造中的最新消息,丹米尔莫,卫报。

法规和政策

“政治宣传”:中国打击访问ChatGPT,海伦戴维森,卫报。

聊天机器人、深度伪造和语音克隆:出售的人工智能欺骗,美国联邦贸易委员会的博客文章。

“我没有给予许可”:人工智能的支持者关心数据法违规吗?,Alex Hern和Dan Milmo,卫报。

意大利的ChatGPT禁令吸引了欧盟隐私监管机构Supantha Mukherjee,Elvira Pollina和Rachel More。

基于公开可用的个人数据训练大型生成AI模型:AI法案可以解决的GDPR难题,Sebastião Barros Vale,数字宪法主义者。

ChatGPT:法律对谁拥有人工智能生成内容的版权有何规定,Sercan Ozcan,Joe Sekhon和Oleksandra Ozcan,The Conversation。

ChatGPT和训练AI的合法基础:混合方法?,Sophie Stalla-Bourdillon和Pablo Trigo Kramcsák,数字宪法主义者。

我们如何想象生成AI监管计划?《来自亚洲的视角》,陈宽伟,《数字宪政主义者》。

版权声明

本文仅代表作者观点,不代表本网站立场。

本文系作者授权本网站发表,未经许可,不得转载。

发表评论