集成学习是使用多个机器学习模型来提高预测的可靠性和准确性。然而,使用多个机器学习模型如何实现更准确的预测呢?使用什么技术来创建集成学习模型?我们将探讨这些问题的答案,了解使用集成模型背后的基本原理以及创建集成模型的主要方法。

简而言之,集成学习是训练多个机器学习模型并将其输出组合在一起的过程。不同的模型被用作创建一个最佳预测模型的基础。组合不同的单独机器学习模型可以提高整体模型的稳定性,从而实现更准确的预测。集成学习模型通常比单个模型更可靠,因此,它们通常在许多机器学习竞赛中名列第一。

工程师可以使用不同的技术来创建集成学习模型。简单的集成学习技术包括对不同模型的输出进行平均等,同时还开发了更复杂的方法和算法,专门用于将许多基础学习器/模型的预测结合在一起。

由于多种原因,机器学习模型可能彼此不同。不同的机器学习模型可以对群体数据的不同样本进行操作,可以使用不同的建模技术,并且可以使用不同的假设。

想象一下,您正在与一大群人玩问答游戏。如果你自己在一个团队中,肯定会有一些你了解的主题,也有很多你不知道的主题。现在假设您正在与其他人一起玩。就像您一样,他们对自己的专业有一些了解,但对其他主题一无所知。然而,当你的知识结合起来时,你对更多领域有更准确的猜测,你的团队缺乏知识的主题数量也会减少。这与集成学习的原理相同,结合不同团队成员(单个模型)的预测来提高准确性并最大限度地减少错误。

统计学家已经证明,当一群人被要求猜测给定问题的正确答案以及一系列可能的答案时,他们的所有答案都会形成一个概率分布。真正知道正确答案的人会自信地选择正确答案,而选择错误答案的人会将他们的猜测分布在可能的错误答案范围内。回到问答游戏的例子,如果你和你的两个朋友知道正确答案是 A,那么你们三个人都会投 A 票,而团队中其他三个不知道答案的人很可能会错猜 B、C、D 或 E。结果是 A 有三票,其他答案可能最多只有一票或两票。

所有模型都存在一定程度的误差。一个模型的误差将不同于另一模型产生的误差,因为模型本身由于上述原因而不同。当检查所有错误时,它们不会聚集在一个或另一个答案周围,而是分散在各处。错误的猜测基本上分布在所有可能的错误答案中,相互抵消。同时,来自不同模型的正确猜测将聚集在真实、正确的答案周围。当使用集成训练方法时,可以更可靠地找到正确答案。

简单的集成训练方法通常只涉及统计汇总技术的应用,例如确定一组预测的模式、平均值或加权平均值。

众数是指一组数字中最常出现的元素。为了获得模式,各个学习模型返回它们的预测,这些预测被视为对最终预测的投票。只需计算预测的算术平均值即可确定预测的平均值,并四舍五入到最接近的整数。最后,可以通过为用于创建预测的模型分配不同的权重来计算加权平均值,权重代表该模型的感知重要性。类别预测的数值表示与 0 到 1.0 之间的权重相乘,然后将各个加权预测相加,并将结果四舍五入到最接近的整数。

存在三种主要的高级集成训练技术,每种技术都旨在处理特定类型的机器学习问题。“装袋”技术用于减少模型预测的方差,方差是指基于相同观察时预测结果的差异程度。“Boosting”技术用于对抗模型的偏差。最后,“堆叠”通常用于改进预测。

集成学习方法本身通常可以分为两个不同的组之一:顺序方法和并行集成方法。

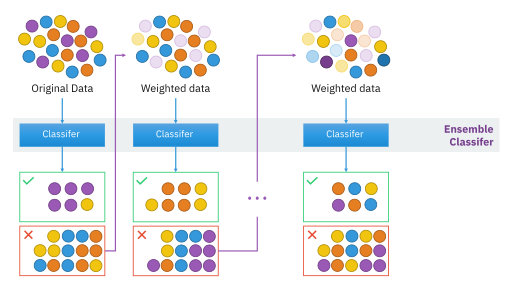

顺序集成方法被称为“顺序”,因为基础学习器/模型是顺序生成的。在顺序方法的情况下,基本思想是利用基学习器之间的依赖性以获得更准确的预测。错误标记的示例会调整其权重,而正确标记的示例则保持相同的权重。每次生成新的学习器时,权重都会发生变化,并且准确性(希望)会提高。

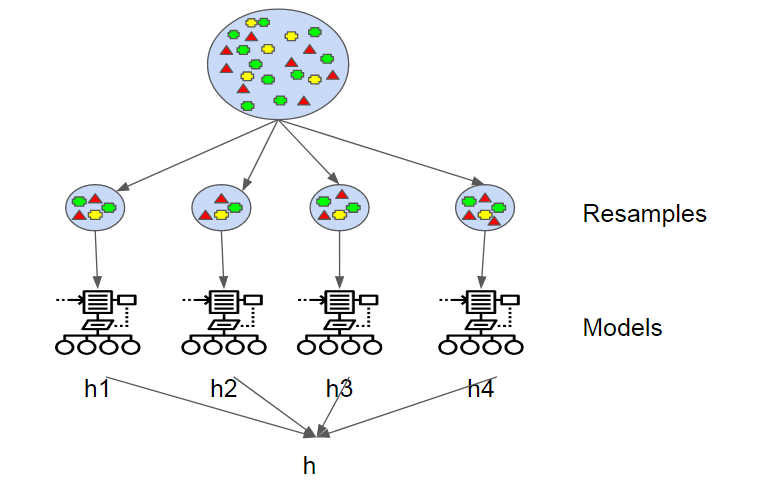

与顺序集成模型相比,并行集成方法并行生成基础学习器。在进行并行集成学习时,其想法是利用基础学习器具有独立性的事实,因为可以通过对各个学习器的预测进行平均来降低总体错误率。

集成训练方法本质上可以是同质的或异质的。大多数集成学习方法都是同质的,这意味着它们使用单一类型的基础学习模型/算法。相比之下,异构集成使用不同的学习算法,使学习者多样化,以确保尽可能高的准确性。

集成学习算法的示例

顺序集成方法的示例包括AdaBoost、XGBoost和梯度树提升。这些都是助推模型。对于这些提升模型,目标是将表现不佳的弱学习者转变为更强大的学习者。像 AdaBoost 和 XGBoost 这样的模型从许多弱学习器开始,它们的表现仅比随机猜测稍好一些。随着训练的继续,权重将应用于数据并进行调整。学习者在前几轮训练中错误分类的实例被赋予更大的权重。重复此过程达到所需的训练轮数后,通过加权和(对于回归任务)和加权投票(对于分类任务)将预测连接在一起。并行集成模型的一个例子是随机森林分类器,随机森林也是装袋技术的一个例子。术语“bagging”来自“引导聚合”。使用称为“引导采样”的采样技术从总数据集中获取样本,基础学习器使用该技术进行预测。对于分类任务,基本模型的输出通过投票进行聚合,而对于回归任务则将它们一起平均。随机森林使用单个决策树作为其基础学习器,并且集合中的每棵树都是使用数据集中的不同样本构建的。特征的随机子集也用于生成树。形成高度随机的个体决策树,将它们组合在一起以提供可靠的预测。

并行集成模型的一个例子是随机森林分类器,随机森林也是装袋技术的一个例子。术语“bagging”来自“引导聚合”。使用称为“引导采样”的采样技术从总数据集中获取样本,基础学习器使用该技术进行预测。对于分类任务,基本模型的输出通过投票进行聚合,而对于回归任务则将它们一起平均。随机森林使用单个决策树作为其基础学习器,并且集合中的每棵树都是使用数据集中的不同样本构建的。特征的随机子集也用于生成树。形成高度随机的个体决策树,将它们组合在一起以提供可靠的预测。

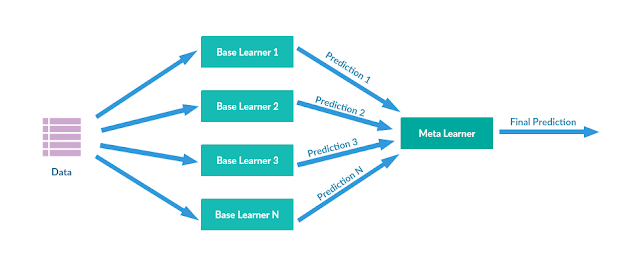

在堆叠集成技术方面,多个回归或分类模型通过更高级别的元模型组合在一起。较低级别的基础模型通过输入整个数据集进行训练。然后将基本模型的输出用作特征来训练元模型。堆叠集成模型本质上通常是异构的。

版权声明

本文仅代表作者观点,不代表本网站立场。

本文系作者授权本网站发表,未经许可,不得转载。

发表评论