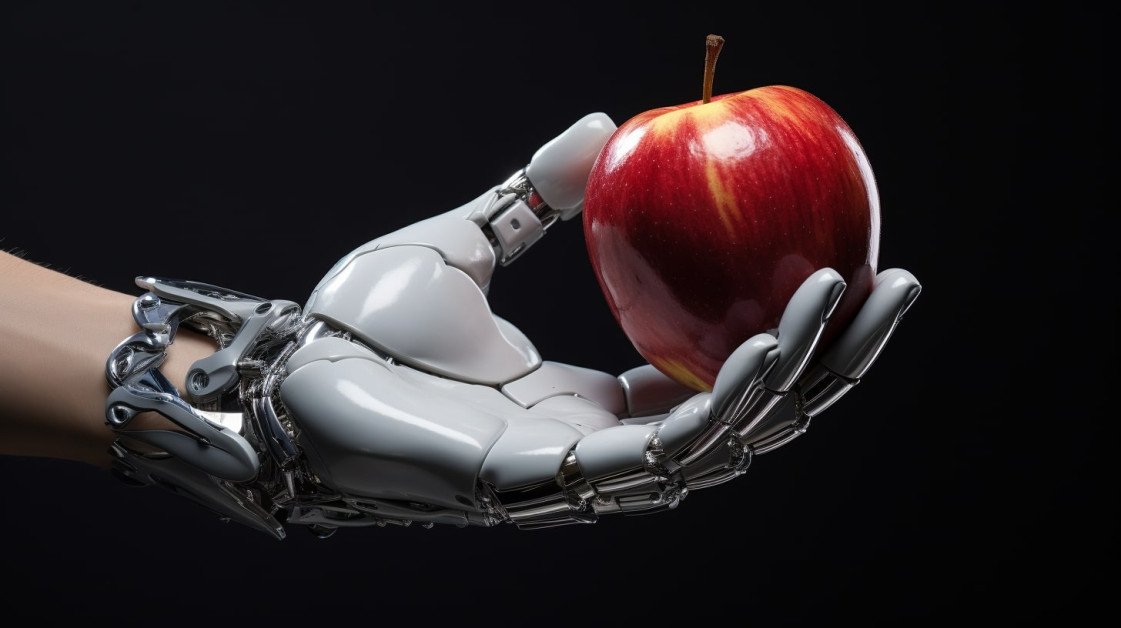

在一项突破性的开发中,加州大学圣地亚哥分校 (UCSD) 的工程师团队设计了一款机械手,可以仅通过触摸来旋转物体,而无需视觉输入。这种创新方法的灵感来自于人类无需看到物体即可轻松处理物体的方式。

该团队为四指机械手配备了 16 个触摸传感器,分布在其手掌和手指上。每个传感器的成本约为 12 美元,执行一个简单的功能:检测物体是否正在接触它。这种方法是独一无二的,因为它依赖于大量低成本、低分辨率的触摸传感器,这些传感器使用简单的二进制信号(触摸或不触摸)来执行机器人手中的旋转。

相比之下,其他方法依赖于固定在机器人手的一小块区域(主要是指尖)上的一些高成本、高分辨率的触摸传感器。领导这项研究的加州大学圣地亚哥分校电气与计算机工程系教授王小龙解释说,这些方法有一些局限性。它们最大限度地减少了传感器与物体接触的机会,从而限制了系统的传感能力。提供纹理信息的高分辨率触摸传感器极其难以模拟,而且价格昂贵,使得在现实世界的实验中使用它们具有挑战性。

“我们表明,我们不需要物体纹理的细节来完成这项任务。我们只需要简单的二进制信号来表明传感器是否接触到物体,这些信号更容易模拟并传输到现实世界。”

该团队使用虚拟机械手旋转一组不同物体(包括不规则形状的物体)的模拟来训练他们的系统。该系统会评估旋转过程中任何给定时间点上的物体正在接触手上的哪些传感器。它还评估手部关节的当前位置以及它们之前的动作。利用这些信息,系统指示机器人手在下一个时间点哪个关节需要移动到哪里。

研究人员在现实生活中的机器人手上用系统尚未遇到的物体测试了他们的系统。机械手能够旋转各种物体,而不会停顿或失去控制。这些物体包括一个西红柿、一个辣椒、一罐花生酱和一只玩具橡皮鸭,由于其形状,这是最具挑战性的物体。形状越复杂的物体旋转所需的时间就越长。机械手还可以围绕不同的轴旋转物体。

该团队现在正致力于将他们的方法扩展到更复杂的操作任务。例如,他们目前正在开发技术,使机械手能够捕捉、投掷和杂耍等。“手动操作是我们人类所拥有的一项非常常见的技能,但对于机器人来说掌握起来非常复杂,”王说。“如果我们能够赋予机器人这种技能,那就将为它们执行各种任务打开大门。”

这一发展标志着机器人领域向前迈出了重要一步,可能为能够在黑暗或视觉挑战性环境中操纵物体的机器人铺平道路。

版权声明

本文仅代表作者观点,不代表本网站立场。

本文系作者授权本网站发表,未经许可,不得转载。

发表评论